Uverljiva nova studija iz Nemačke kritikuje EU AI Act’s definicija pojma ‘deepfake’ kao preterano nejasna, naročito u kontekstu manipulacije digitalnom slikom. Autori tvrde da je naglasak Zakona na sadržaju koji nalikuje stvarnim osobama ili događajima – ali potencijalno pojavljuju lažno – nedostaje jasnoće.

Oni također ističu da iznimke Zakona za ‘standardno uređivanje’ (tj. navodno manje modifikacije slika uz pomoć umjetne inteligencije) ne uzimaju u obzir sveprisutni utjecaj umjetne inteligencije u aplikacijama za potrošače niti subjektivnu prirodu umjetničkih konvencija koje prethode pojavi umjetne inteligencije.

Neprecizno zakonodavstvo o ovim pitanjima dovodi do dva ključna rizika: ‘utjecaj odvraćanja’, gdje široki opseg tumačenja zakona guši inovacije i usvajanje novih sustava; i ‘efekt ismijavanja’, gdje se zakon zanemaruje kao pretjeran ili irelevantan.

U oba slučaja, nejasni zakoni djelotvorno prebacuju odgovornost uspostavljanja praktičnih pravnih definicija na buduće sudske presude – oprezan i nesklon riziku pristup zakonodavstvu.

Čini se da su tehnologije za manipulaciju slikama temeljene na umjetnoj inteligenciji znatno ispred kapaciteta zakonodavstva da ih riješi. Na primjer, jedan značajan primjer sve veće elastičnosti koncepta ‘automatske’ naknadne obrade vođene umjetnom inteligencijom, primjećuje se u radu, jest ‘Optimizator scene’ funkcija u novijim Samsung fotoaparatima, koja može zamijeniti fotografije mjeseca koje su snimili korisnici (a izazovno predmet), s ‘rafiniranom’ slikom vođenom umjetnom inteligencijom:

Gore lijevo, primjer iz novog rada stvarne slike mjeseca koju je snimio korisnik, lijevo od Samsung poboljšane verzije koja je automatski stvorena pomoću Scene Optimizer; Točno, Samsungova službena ilustracija procesa iza ovoga; dolje lijevo, primjeri korisnika Reddita u/ibreakphotos, koji prikazuje (lijevo) namjerno zamućenu sliku mjeseca i (desno), Samsungovo ponovno zamišljanje ove slike – iako je izvorna fotografija bila slika monitora, a ne pravi mjesec. Izvori (u smjeru kazaljke na satu od gore lijevo): https://arxiv.org/pdf/2412.09961; https://www.samsung.com/uk/support/mobile-devices/how-galaxy-cameras-combine-super-resolution-technologies-with-ai-to-produce-high-quality-images-of-the- mjesec/; https://reddit.com/r/Android/comments/11nzrb0/samsung_space_zoom_moon_shots_are_fake_and_here/

U donjem lijevom dijelu gornje slike vidimo dvije slike mjeseca. Lijevo je fotografija poduzete od strane korisnika Reddita. Ovdje je slika namjerno zamućena i smanjena od strane korisnika.

S njegove desne strane vidimo fotografiju iste degradirane slike snimljene Samsung kamerom s omogućenom naknadnom obradom vođenom umjetnom inteligencijom. Kamera je automatski ‘povećala’ prepoznati objekt ‘mjesec’, iako to nije bio pravi mjesec.

Rad iznosi dublju kritiku na Najbolje uzeti značajka ugrađena u novije Googleove pametne telefone – a kontroverzan Značajka umjetne inteligencije koja zajedno uređuje ‘najbolje’ dijelove grupne fotografije, skenira više sekundi sekvence fotografije tako da se osmjesi po potrebi pomiču naprijed ili unatrag – i nitko se ne prikazuje usred treptanja.

U radu se tvrdi da ova vrsta složenog procesa ima potencijal pogrešnog predstavljanja događaja:

‘[U] tipičnoj postavci grupne fotografije, prosječni gledatelj vjerojatno bi rezultirajuću fotografiju smatrao autentičnom. Osmijeh koji je umetnut postojao je unutar nekoliko sekundi od snimanja preostale fotografije.

‘S druge strane, vremenski okvir od deset sekundi najboljeg snimanja dovoljan je za promjenu raspoloženja. Osoba se možda prestala smiješiti dok se ostatak grupe smije šali na njihov račun.

‘Kao posljedica toga, pretpostavljamo da bi takva grupna fotografija mogla predstavljati duboki lažnjak’.

Korištenje električnih romobila ističe novom papiru naslovljen je Što čini Deep Fake? Nejasna granica između legitimne obrade i manipulacije prema EU Zakonu o umjetnoj inteligenciji, a dolazi od dva istraživača u Laboratoriju za računalno pravo na Sveučilištu u Tübingenu i Sveučilištu Saarland.

Stari trikovi

Manipuliranje vremenom u fotografiji daleko je starije od umjetne inteligencije na razini potrošača. Autori novog rada primjećuju postojanje mnogo starijih tehnika koje se mogu smatrati ‘neautentičnim’, kao što je ulančavanje više uzastopnih slika u Visoki dinamički raspon (HDR) fotografija ili a ‘sašiven’ panoramska fotografija.

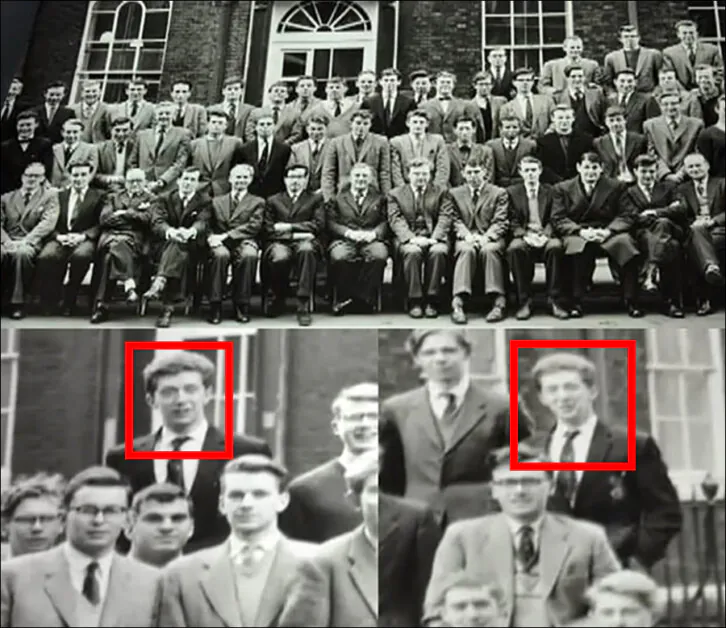

Doista, neke od najstarijih i najzabavnijih lažnih fotografija tradicionalno su stvarala školska djeca trčeći s jednog kraja školske grupe na drugi, ispred putanje posebnog panoramske kamere koje su se nekada koristile za sportsko i školsko grupno fotografiranje – što je omogućilo učeniku da se pojavi dvaput na istoj slici:

Iskušenju da prevare panoramske kamere tijekom grupnih fotografija bilo je teško odoljeti mnogim učenicima, koji su bili spremni riskirati lošu sjednicu u uredu ravnatelja kako bi se ‘klonirali’ na školskim fotografijama. Izvor: https://petapixel.com/2012/12/13/double-exposure-a-clever-photo-prank-from-half-a-century-ago/

Osim ako ne snimite fotografiju u RAW načinu rada, koji u osnovi prebacuje senzor objektiva fotoaparata u vrlo veliku datoteku bez ikakve interpretacije, vjerojatno je da vaše digitalne fotografije nisu potpuno autentične. Sustavi kamera rutinski primjenjuju algoritme ‘poboljšanja’ kao što su izoštravanje slike i ravnoteža bijele, prema zadanim postavkama – i to rade od početka digitalne fotografije na razini potrošača.

Autori novog rada tvrde da čak ni te starije vrste povećanja digitalnih fotografija ne predstavljaju ‘stvarnost’, budući da su takve metode osmišljene kako bi fotografije bile ugodnije, a ne ‘stvarnije’.

Studija sugerira da EU AI Act, čak i s kasnijim izmjenama i dopunama kao što je recitali 123–27, smješta sav fotografski izlaz unutar dokazni okvir neprilagođen kontekstu u kojem se fotografije proizvode ovih dana, za razliku od (nominalno objektivne) prirode snimaka sigurnosnih kamera ili forenzičke fotografije. Vjerojatnije je da će većina slika na koje se odnosi Zakon o umjetnoj inteligenciji potjecati iz konteksta u kojima su proizvođači i internetske platforme aktivno promovirati kreativna interpretacija fotografija, uključujući korištenje AI.

Istraživači sugeriraju da fotografije ‘nikada nisu bile objektivan prikaz stvarnosti’. Razmatranja kao što su položaj fotoaparata, odabrana dubinska oštrina i odabir osvjetljenja, doprinose tome da fotografija bude duboko subjektivna.

Rad primjećuje da su rutinski zadaci ‘čišćenja’ – poput uklanjanja senzorske prašine ili neželjenih električnih vodova s inače dobro sastavljene scene – samo polu-automatizirano prije uspona umjetne inteligencije: korisnici su morali ručno odabrati regiju ili pokrenuti postupak kako bi postigli željeni ishod.

Danas se te operacije često pokreću korisničkim tekstualnim uputama, ponajviše u alatima poput Photoshopa. Na razini potrošača takve su značajke sve više automatizirane bez korisnički unos – ishod koji proizvođači i platforme očito smatraju ‘očito poželjnim’.

Razvodnjeno značenje ‘Deepfake’

Središnji izazov za zakonodavstvo u vezi sa slikama koje je izmijenila i generirala umjetna inteligencija dvosmislenost je izraza ‘deepfake’, čije je značenje znatno prošireno tijekom posljednje dvije godine.

Izvorno su se uvjeti odnosili samo na video izlaz iz sustavi temeljeni na autokoderu kao što su DeepFaceLab i FaceSwap, oba izvedena iz anonimnog koda objavljenog na Redditu krajem 2017.

Od 2022. dolazak Modeli latentne difuzije (LDM) kao što je Stabilna difuzija i Tok, kao i sustave za pretvaranje teksta u video kao što su Sora, također bi omogućio zamjenu identiteta i prilagodbu, uz poboljšanu rezoluciju, svestranost i vjernost. Sada je bilo moguće stvoriti modele temeljene na difuziji koji mogu prikazati slavne osobe i političara. Budući da je pojam ‘deepfake’ već bio dragocjenost medijskih producenata, proširio se na te sustave.

Kasnije se taj izraz počeo uključivati iu medijima iu istraživačkoj literaturi lažno predstavljanje temeljeno na tekstu. Do ove točke, izvorno značenje ‘deepfakea’ bilo je gotovo izgubljeno, dok se njegovo prošireno značenje neprestano razvijalo i sve više razvodnjavalo.

Ali budući da je riječ bila tako zapaljiva i stimulirajuća, a do sada je bila moćan politički i medijski kamen, pokazalo se nemogućim odustati. Privukao je čitatelje na web stranice, financiranje istraživačima i pozornost na političare. Ova leksička višeznačnost glavni je fokus novog istraživanja.

Kao što autori primjećuju, članak 3(60) EU AI Act ističe četiri uvjeta koji definiraju ‘deepfake’.

1: Pravi Mjesec

Prvo, sadržaj mora biti generirani ili manipulirani, tj. ili stvoren od nule pomoću AI (generacija) ili izmijenjen iz postojećih podataka (manipulacija). Rad naglašava poteškoće u razlikovanju ‘prihvatljivih’ ishoda uređivanja slika i manipulativnih deepfakeova, s obzirom na to da digitalne fotografije, u svakom slučaju, nikada nisu pravi prikazi stvarnosti.

Rad tvrdi da je mjesec koji je generirao Samsung nedvojbeno autentičan, budući da mjesec vjerojatno neće promijeniti izgled, a budući da je sadržaj generiran umjetnom inteligencijom, obučen na stvarnim lunarnim slikama, stoga vjerojatno točan.

Međutim, autori također navode da budući da se pokazalo da Samsungov sustav generira ‘poboljšanu’ sliku Mjeseca u slučaju kada izvorna slika nije sam Mjesec, to bi se smatralo ‘deepfakeom’.

Bilo bi nepraktično sastaviti sveobuhvatan popis različitih slučajeva upotrebe oko ove vrste ad hoc funkcionalnost. Stoga se čini da teret definiranja ponovno prelazi na sudove.

2: TextFakes

Drugo, sadržaj mora biti u obliku slike, zvuka ili videa. Tekstualni sadržaj, iako podliježe drugim obvezama transparentnosti, ne smatra se deepfakeom prema Zakonu o umjetnoj inteligenciji. Ovo nije detaljno obrađeno u novoj studiji, iako može imati značajan utjecaj na učinkovitost Vizualni deepfakes (vidi dolje).

3: Problemi stvarnog svijeta

Treće, sadržaj mora nalikuju na postojeće osobe, predmete, mjesta, entitete ili događaje. Ovaj uvjet uspostavlja vezu sa stvarnim svijetom, što znači da se čisto izmišljene slike, čak i ako su fotorealistične, ne bi kvalificirale kao deepfake. Uvodna izjava 134 Zakona o AI-ju EU-a naglašava aspekt ‘sličnosti’ dodavanjem riječi ‘primjetno’ (prividno odgađanje kasnijih pravnih presuda).

Autori, cit raniji rad, razmislite treba li lice koje je generirala umjetna inteligencija pripadati stvarnoj osobi ili samo mora biti adekvatno sličan stvarnoj osobi, kako bi se zadovoljila ova definicija.

Na primjer, kako se može utvrditi da li niz fotorealističnih slika koje prikazuju političara Donalda Trumpa ima namjeru lažnog predstavljanja, ako ga slike (ili priloženi tekstovi) ne spominju izričito? prepoznavanje lica? Korisničke ankete? Sudčeva definicija ‘zdravog razuma’?

Vraćajući se na problem ‘TextFakes’ (vidi gore), riječi često čine značajan dio čina Vizualni deepfake. Na primjer, moguće je snimiti (nepromijenjenu) sliku ili videozapis ‘osoba a’i recimo, u opisu ili objavi na društvenim mrežama, da je slika od ‘osoba b’ (pod pretpostavkom da dvije osobe imaju sličnosti).

U takvom slučaju, nije potrebna umjetna inteligencija, a rezultat bi mogao biti nevjerojatno učinkovit – no predstavlja li takav niskotehnološki pristup i ‘deepfake’?

4: Retuširanje, pregradnja

Konačno, sadržaj mora nekoj osobi izgledati autentično ili istinito. Ovaj uvjet naglašava percepcija ljudskih gledatelja. Sadržaj koji samo algoritam prepoznaje kao da predstavlja stvarnu osobu ili objekt bi ne smatrati deepfakeom.

Od svih uvjeta u 3(60), ovaj se najočiglednije odnosi na kasniju sudsku presudu, budući da ne dopušta bilo kakvo tumačenje putem tehničkih ili mehaniziranih sredstava.

Jasno je da postoje neke inherentne poteškoće u postizanju konsenzusa o takvoj subjektivnoj odredbi. Autori primjećuju, na primjer, da različiti ljudi i različite vrste ljudi (kao što su djeca i odrasli) mogu biti različito skloni vjerovati u određeni deepfake.

Autori nadalje primjećuju da napredne AI mogućnosti alata poput Photoshopa izazivaju tradicionalne definicije ‘deepfakea’. Iako ti sustavi mogu uključivati osnovne mjere zaštite od kontroverznog ili zabranjenog sadržaja, oni dramatično proširuju koncept ‘retuširanja’. Korisnici sada mogu dodavati ili uklanjati objekte na vrlo uvjerljiv, fotorealističan način, postižući profesionalnu razinu autentičnosti koja redefinira granice manipulacije slikama.

Autori navode:

‘Tvrdimo da trenutna definicija dubokih krivotvorina u Zakonu o umjetnoj inteligenciji i odgovarajuće obveze nisu dovoljno specificirane da bi se uhvatilo u koštac s izazovima koje predstavljaju duboke krivotvorine. Analizirajući životni ciklus digitalne fotografije od senzora fotoaparata do značajki digitalnog uređivanja, otkrivamo sljedeće:

‘(1.) Duboke krivotvorine loše su definirane u Zakonu o umjetnoj inteligenciji EU-a. Definicija ostavlja previše prostora za ono što je duboko lažiranje.

‘(2.) Nije jasno kako se funkcije uređivanja poput Googleove značajke „najboljeg snimanja“ mogu smatrati iznimkom od obveza transparentnosti.

‘(3.) Iznimka za znatno uređene slike postavlja pitanja o tome što predstavlja značajno uređivanje sadržaja i mora li to uređivanje biti vidljivo fizičkoj osobi ili ne.’

Uzimanje iznimke

EU AI Act sadrži iznimke koje, tvrde autori, mogu biti vrlo popustljive. Članak 50 (2), navode oni, nudi iznimku u slučajevima kada većina originalne izvorne slike nije promijenjena. Autori napominju:

Što se može smatrati sadržajem u smislu članka 50. stavka 2. u slučajevima digitalnog zvuka, slika i videa? Na primjer, u slučaju slika, trebamo li uzeti u obzir prostor piksela ili vidljivi prostor koji ljudi percipiraju? Značajne manipulacije u prostoru piksela možda neće promijeniti ljudsku percepciju, a s druge strane, male perturbacije u prostoru piksela mogu dramatično promijeniti percepciju.’

Istraživači daju primjer dodavanja pištolja na fotografiju osobe koja upire u nekoga. Dodavanjem pištolja mijenja se samo 5% slike; međutim, semantičko značenje promijenjenog dijela je vidljivo. Stoga se čini da ova iznimka ne uzima u obzir nikakvo ‘zdravorazumsko’ shvaćanje učinka koji mali detalj može imati na ukupni značaj slike.

Odjeljak 50(2) također dopušta iznimke za ‘pomoćnu funkciju za standardno uređivanje’. Budući da Zakon ne definira što znači ‘standardno uređivanje’, čak i ekstremne značajke naknadne obrade kao što je Googleov Best Take bile bi zaštićene ovom iznimkom, primjećuju autori.

Zaključak

Navedena namjera novog rada je potaknuti interdisciplinarna istraživanja oko regulacije deepfakeova i djelovati kao polazište za nove dijaloge između računalnih znanstvenika i pravnih znanstvenika.

Međutim, sam dokument podlijegao je tautologiji u nekoliko točaka: često koristi izraz ‘deepfake’ kao da je njegovo značenje samoočigledno, dok cilja na EU AI Act jer nije uspio definirati što zapravo predstavlja deepfake.

Izvor: Unite.ai